详细介绍

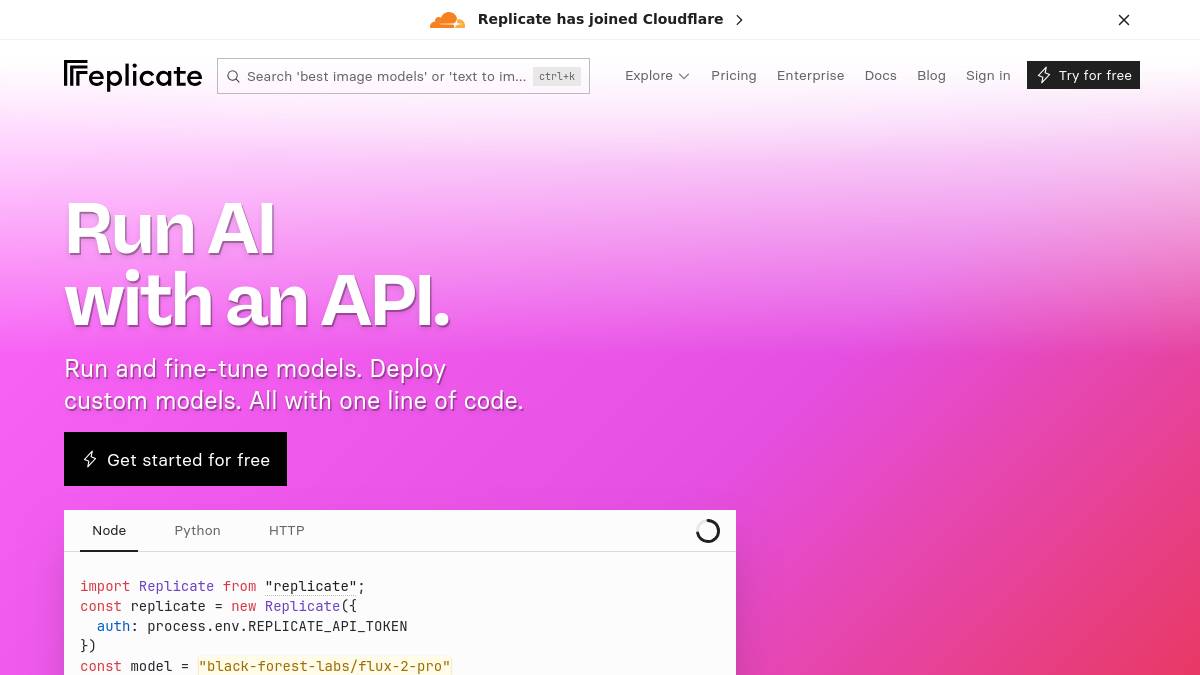

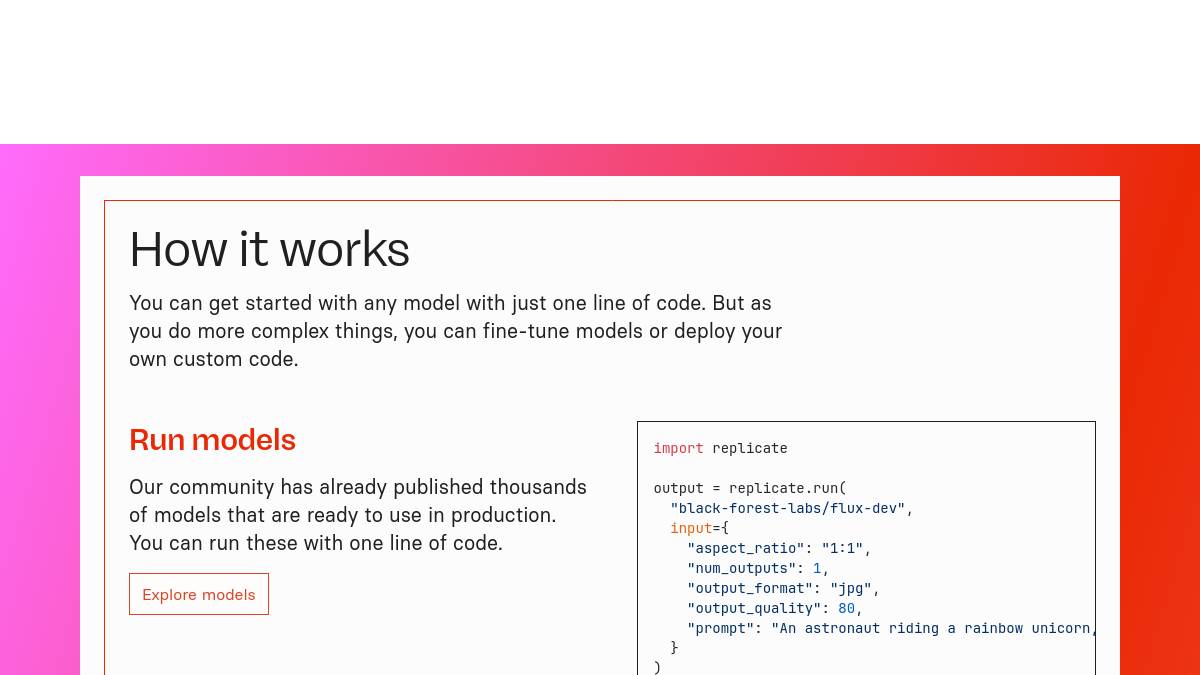

Replicate 是一个**云平台**,用于**运行和部署开源机器学习模型**。它的核心使命是让开发者无需管理底层基础设施,就能轻松调用、微调和托管 AI 模型(如图像生成、语音合成、文本生成等),将模型快速集成到自己的应用中。

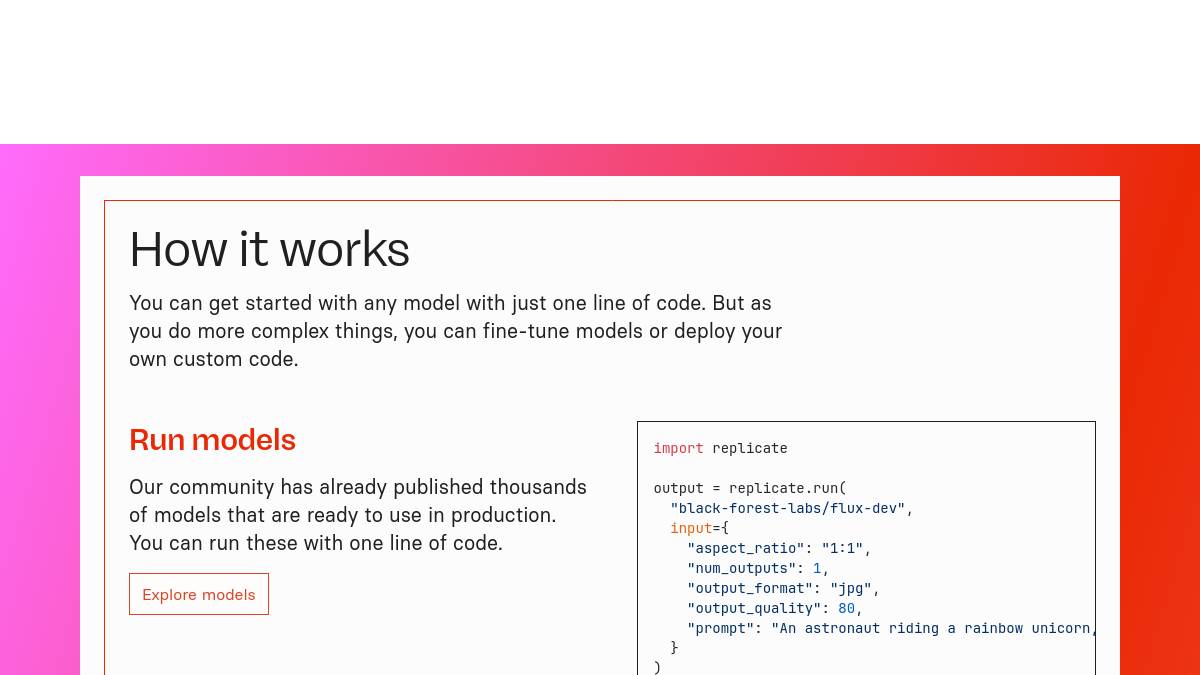

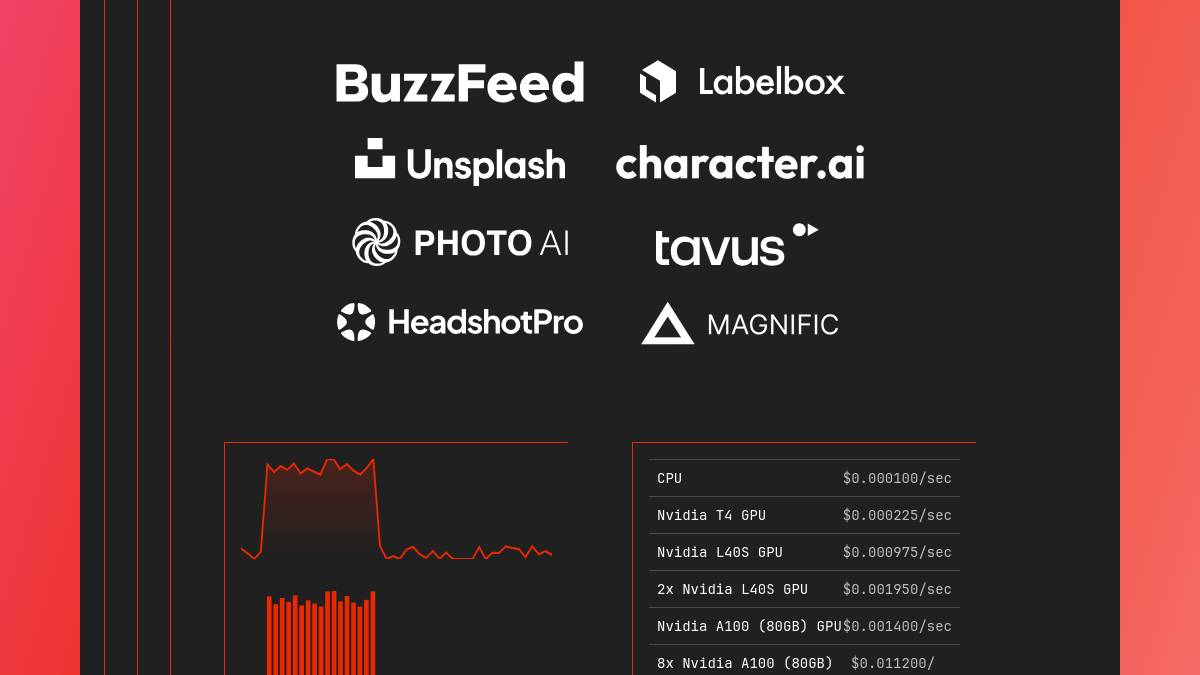

通过提供统一的 API、预配置的模型库和自动扩缩容的 GPU 资源,Replicate 帮助开发者跳过复杂的模型部署流程,直接使用或自定义最先进的开源 AI 模型,显著降低 AI 应用开发门槛。

📊 核心价值与量化收益

🧱 核心技术模块

| 模块 | 功能描述 |

|---|---|

| 模型即服务(MaaS) | 提供数千个预部署的开源模型(如 Llama、Stable Diffusion、Whisper 等),通过简单 API 即可调用,无需自行部署。 |

| 自定义模型部署 | 开发者可上传自己的模型(支持 PyTorch、TensorFlow 等),Replicate 自动容器化并提供可扩展的 API 端点。 |

| Cog 框架 | 开源工具,用于将任意机器学习模型打包为可预测、可复现的 Docker 容器,便于在 Replicate 或其他平台部署。 |

| 按需 GPU 资源 | 自动分配 A100、A10G、T4 等 GPU,支持自动扩缩容,仅在模型运行时计费。 |

| Webhook 与异步预测 | 支持长时间运行任务(如视频生成),通过 Webhook 回调通知结果,避免请求超时。 |

| 版本控制与复现 | 每个模型部署都有唯一版本,确保结果可复现,便于调试和回滚。 |

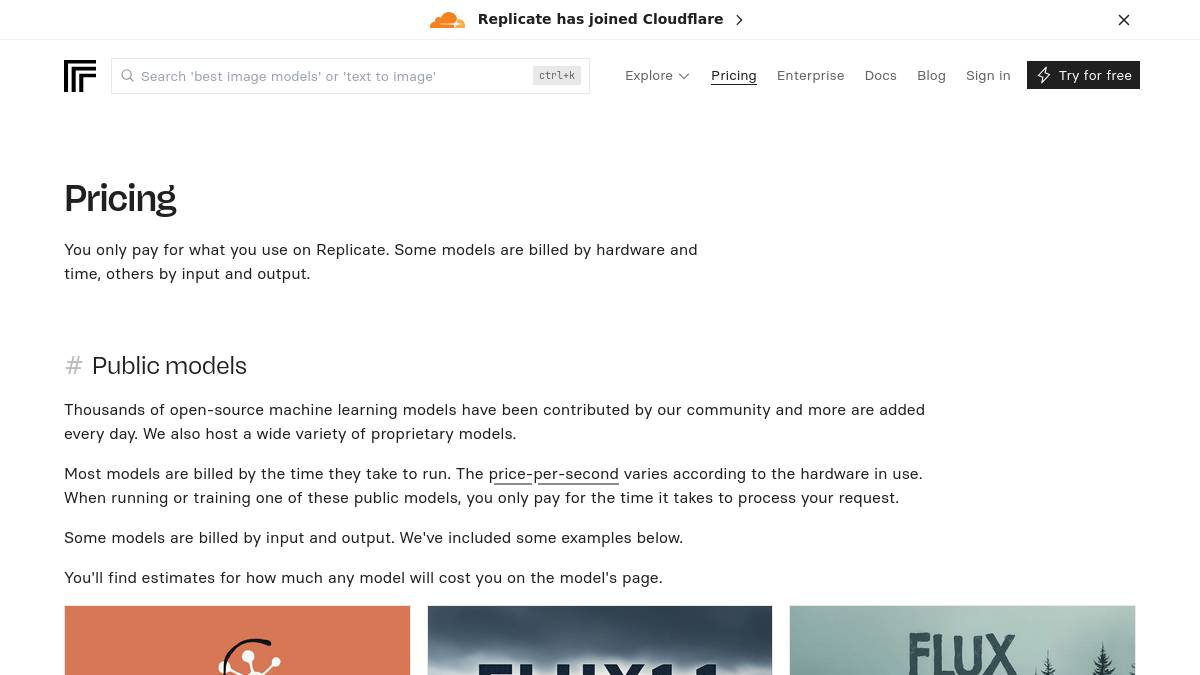

💰 定价方案

Replicate 采用**按实际使用量计费**模式,无月租费。费用基于模型运行时消耗的 GPU 秒数,不同 GPU 类型单价不同。新用户赠送 $10 免费额度。

| 资源类型 | 价格(每秒) | 适用场景 | 备注 |

|---|---|---|---|

| A100 (40GB) | $0.00039 | 大模型推理(如 Llama 3、SDXL) | 高性能,高成本 |

| A10G | $0.00014 | 中等规模图像/文本生成 | 性价比高 |

| T4 | $0.00006 | 轻量级模型、语音识别等 | 低成本入门 |

| 免费额度 | $10 | 所有新用户 | 一次性赠送 |

🎯 解决的核心商业问题

| 开发痛点 | 导致的后果 | Replicate 的解决方案 |

|---|---|---|

| 模型部署复杂 | 需要深度学习 DevOps 技能,耗费大量时间配置环境、优化性能。 | 提供一键部署的预训练模型库,或通过 Cog 框架简化自定义模型上线流程。 |

| GPU 成本不可控 | 长期租用 GPU 服务器成本高昂,空闲时仍需付费。 | 按秒计费,仅在模型实际运行时消耗资源,无闲置成本。 |

| 缺乏标准化接口 | 每个模型需单独开发 API,维护成本高。 | 统一 RESTful API 和 SDK,调用任何模型只需几行代码。 |

| 结果不可复现 | 模型版本、依赖环境不一致导致输出差异,影响产品稳定性。 | 每个部署自动版本化,确保输入相同则输出一致。 |

使用场景

给电商商品图自动换背景

我们每天要上新几十款商品,拍完照片还得一张张抠图换白底,设计师根本忙不过来,有没有办法自动搞定?

用 Replicate 调用开源的图像分割模型(比如 Segment Anything),通过一行 API 代码自动抠出商品主体,再叠加纯色背景,批量处理几千张图也不用管服务器。

把用户语音留言转成文字客服工单

客户经常发语音消息咨询问题,但客服团队没法边听边记,漏掉关键信息怎么办?

在客服系统里集成 Replicate 上的 Whisper 语音识别模型,上传语音后自动返回高准确率文字,直接生成工单摘要,连方言口音都能处理。

快速生成短视频口播配音

做抖音带货视频总找不到合适的配音员,自己录又没时间,AI 配音要么太机械要么贵得离谱,咋办?

用 Replicate 部署开源的语音合成模型(如 Bark 或 VITS),输入文案就能生成带情绪、语速自然的中文配音,还能选不同音色,导出音频直接剪进视频。

自动生成产品使用教程截图配文

每次更新 App 功能都得手动截屏+写说明文字,运营同事天天催素材,能不能让 AI 帮忙?

把界面截图传给 Replicate 上的 BLIP 或 LLaVA 多模态模型,它能自动分析图片内容并生成简洁的操作指引文案,比如‘点击右上角齿轮图标进入设置’。

给老照片修复划痕和上色

家里翻出一堆泛黄的老照片想做成电子相册,但全是折痕和褪色,修图软件太难搞了!

用 Replicate 调用 GFPGAN 或 Real-ESRGAN 这类图像修复模型,上传旧照片自动去除噪点、填补破损,再接一个 DeOldify 模型一键智能上色,几分钟出高清版。

常见问题

用户评分

为此工具评分